你有没有遇到过这种情况:每次让 AI 写代码,都要从头解释一遍背景。“这个功能是给谁用的?” “为什么要这样设计?” “上次客户怎么说的?” 解释完一轮,AI 写出来的代码还是不对,你又得重新调整。反反复复,还不如自己写。

Elvis 是个独立开发者,最近他分享了自己的真实案例,不直接让 AI 写代码,而是让一个“AI 项目经理”来管理一群“AI 程序员”。

而且他的 AI 项目经理(叫 Zoe)还会主动干活。Elvis 开完客户会议去散个步,回来就收到通知:“7 个功能做好了,等你审查。”

他的工作从“敲代码”变成了“做决策”,只需要看看截图、点点确认,功能就上线了。

这篇文章里我会把整套系统拆开给你看,包括它怎么运作、要花多少钱、普通人怎么复制。

为什么要有个“AI 项目经理”?

很多人以为,用更强的 AI 模型就能解决问题。

其实不是。

因为AI 的“记忆力”是有限的。你要么让它记住你的代码,要么让它记住你的业务背景,两个不能兼得。所以直接用 AI 写代码效率低,它要么懂代码但不懂你的业务,要么了解需求但写不出好代码。

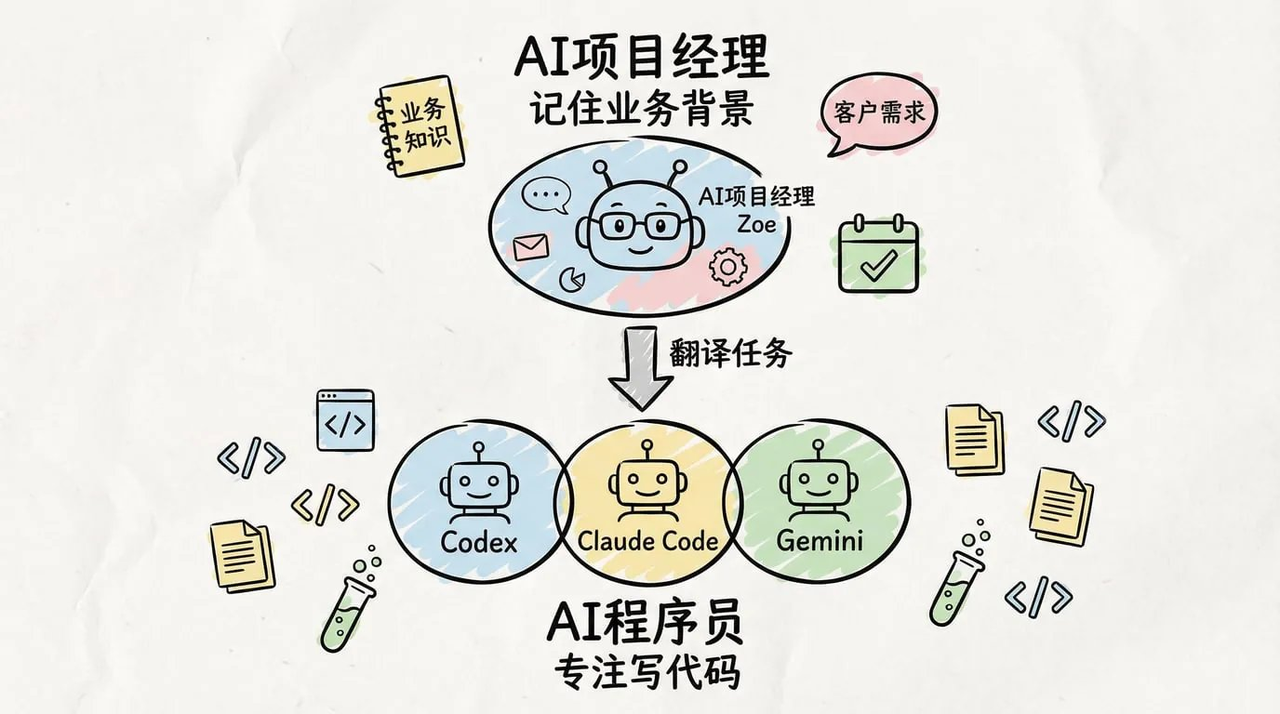

Elvis 的解决办法很聪明:分两层。

第一层是 AI 项目经理(Zoe),她记住所有业务信息:客户是谁、他们要什么、之前试过什么方案、哪些成功了哪些失败了。这些信息都存在 Obsidian 笔记里,Zoe 随时能查。

第二层是 AI 程序员(Codex、Claude Code、Gemini),他们只管写代码。Zoe 会把业务需求“翻译”成详细的任务说明,分配给合适的 AI 程序员。程序员只看代码,项目经理负责大局。

这个架构和 Stripe(硅谷大公司)最近公开的系统一模一样。区别是,Stripe 的系统要几十万美元,Elvis 的系统运行在他自己的电脑上,成本只是零头。

Elvis 用这套系统开发真实产品已经 4 周了。客户提需求,他当天就能交付。速度快,客户付费意愿就高,这直接转化成收入。

真实案例:从开会到上线只用 70 分钟

接下来我用 Elvis 的一个真实例子,展示这套系统怎么工作。

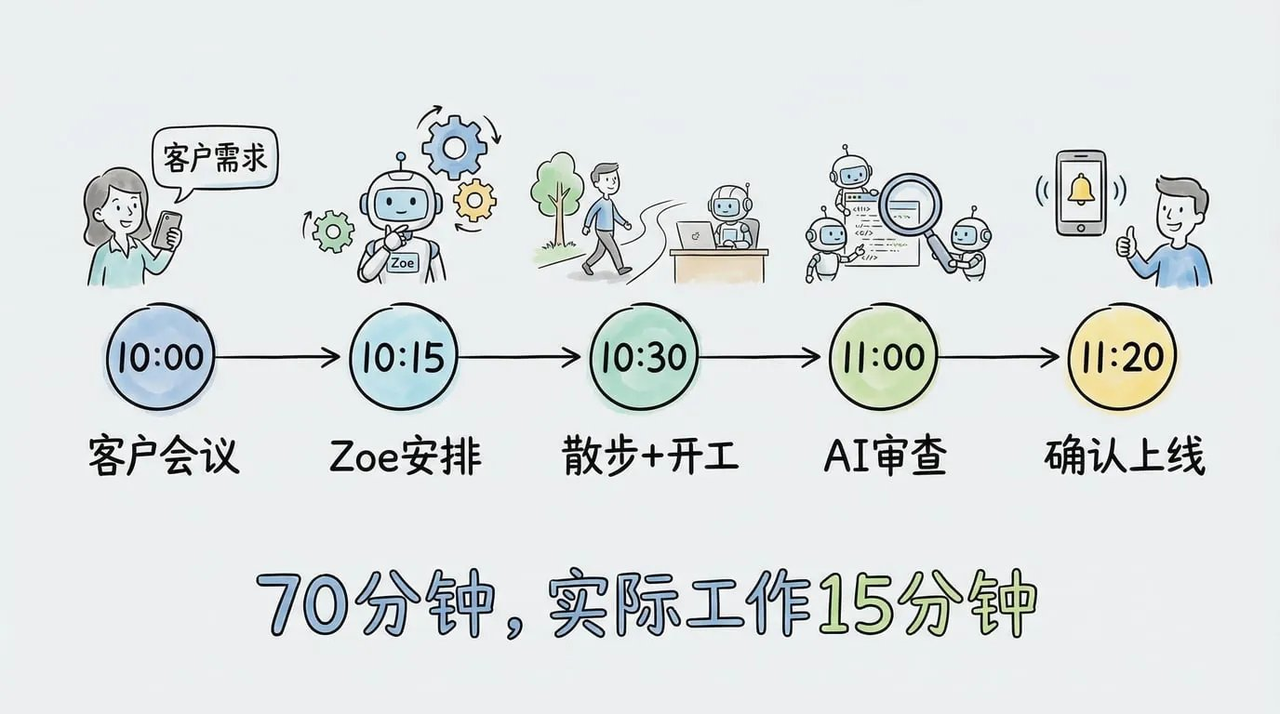

上午 10:00 - 客户打电话

客户说:我们团队想复用之前设置好的配置,每次都要重新设置太麻烦了。

Elvis 没有打开编辑器写代码,而是和 Zoe 聊了几句。因为所有会议记录都自动保存在笔记里,Zoe 已经知道这个客户是谁、做什么业务、之前提过什么需求。很快确定方案:做个模板功能,让客户能保存和重用配置。

上午 10:15 - Zoe 开始安排

Zoe 做了三件事:

给客户账户充值,立即解除限制(它有管理员权限)

从数据库里调出客户现有的配置数据

创建一个 AI 程序员,给它详细的任务说明(包括客户背景、现有数据、技术要求)

上午 10:20 - AI 程序员开工

AI 程序员在一个独立的“工作区”里开始干活:写代码、跑测试、提交代码。进度实时记录在一个文件里。

上午 10:30 到 11:00 - Elvis 去散步

一个自动程序每 10 分钟检查一次:AI 程序员还在工作吗?代码提交了吗?测试通过了吗?如果卡住了或失败了,系统会自动重试(最多 3 次),并给出更详细的说明。

上午 11:00 - 代码提交完成

AI 程序员完成代码,创建了一个“待审查”的提交。但 Elvis 这时还不会收到通知,因为还没完全做好。

系统定义的“做好”标准是:代码提交了、没有冲突、测试全通过、三个 AI 审查员都批准了、有界面截图(如果改了界面的话)。

上午 11:05 到 11:15 - 三个 AI 审查员检查代码

三个不同的 AI 开始审查代码:

Codex:检查逻辑错误和边界情况(最靠谱)

Gemini:找安全问题和性能问题(免费还好用)

Claude Code:做最后验证(有点过于谨慎,Elvis 只看它标记为“严重”的问题)

三个 AI 直接在代码下面写评论。

上午 11:20 - Elvis 收到通知

手机收到消息:“功能 #341 做好了,等你审查。”

这时测试全过了,三个审查员都批准了,还有界面截图。Elvis 花 5 分钟看了看截图和关键评论,点了“确认”。功能上线。

从会议结束到功能上线,总共 70 分钟。Elvis 实际工作时间不到 15 分钟。

这让我意识到,AI 的价值已经不只是“写代码更快”,而是让你从“执行者”变成“决策者”。你不用盯着屏幕敲代码,只需要定义需求、审查结果、做最终决定。

成本对比:190 美元 vs 15 万美元

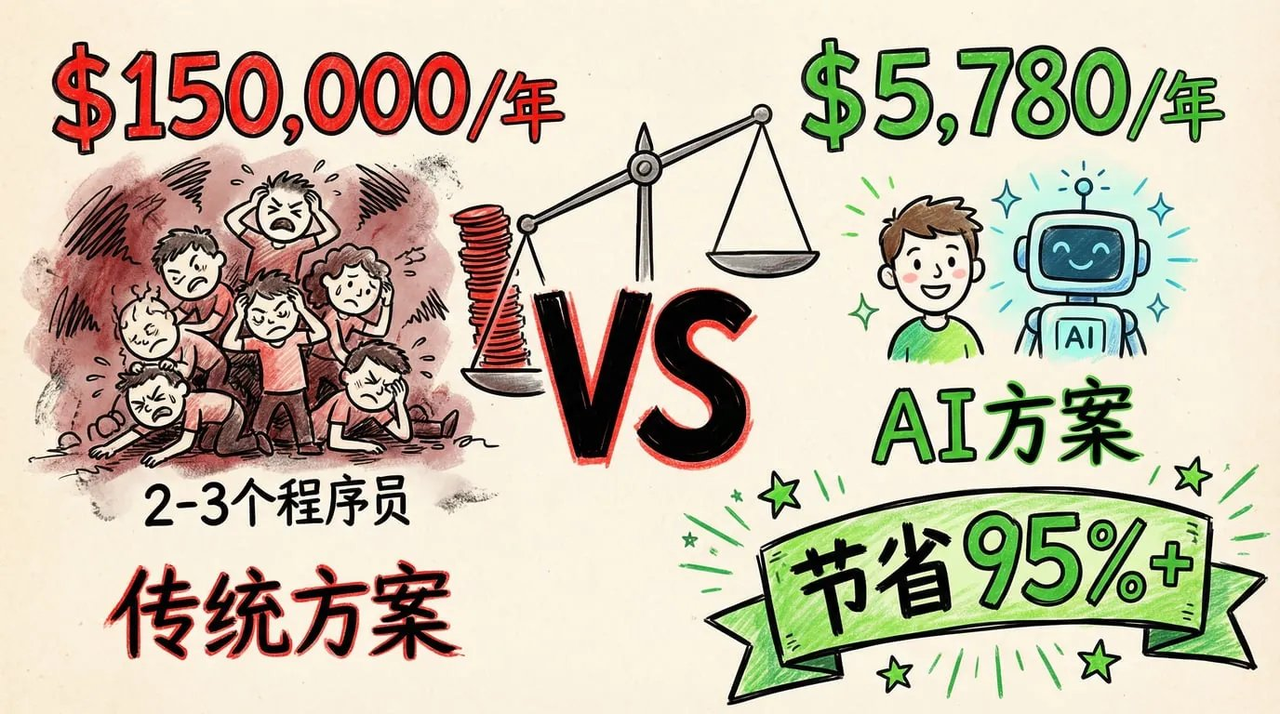

Elvis 每月花费:

Claude API:100 美元

Codex API:90 美元

总计:190 美元/月

如果你刚开始试,可以从 20 美元/月起步。

硬件方面,Elvis 最初用的是 16GB 内存的 Mac Mini,能同时运行 4-5 个 AI 程序员。但每个 AI 都需要独立的工作空间和依赖包,内存很快就不够用了。

所以他买了一台 128GB 内存的 Mac Studio(3,500 美元),能稳定运行 15-20 个 AI 程序员。这是一次性投入。

对比传统方案:雇一个全职程序员,年薪至少 10 万美元(约 8,300 美元/月)。要达到 Elvis 的产出(日均 50 次提交),需要 2-3 个程序员,年成本 20-30 万美元。

Elvis 的系统年成本:2,280 美元(API)+ 3,500 美元(电脑)= 5,780 美元。

节省 95% 以上。

但这里有个关键认知:不要把 AI 当“廉价员工”,要把它当“力量放大器”。

Elvis 做最重要的工作:决定产品方向、理解客户需求、审查代码质量、做架构决策。AI 接管的是重复性的编码、测试、文档工作。

这种分工让 Elvis 能专注于只有人类能做好的事:判断、创造、沟通。

怎么搭建:五个关键步骤

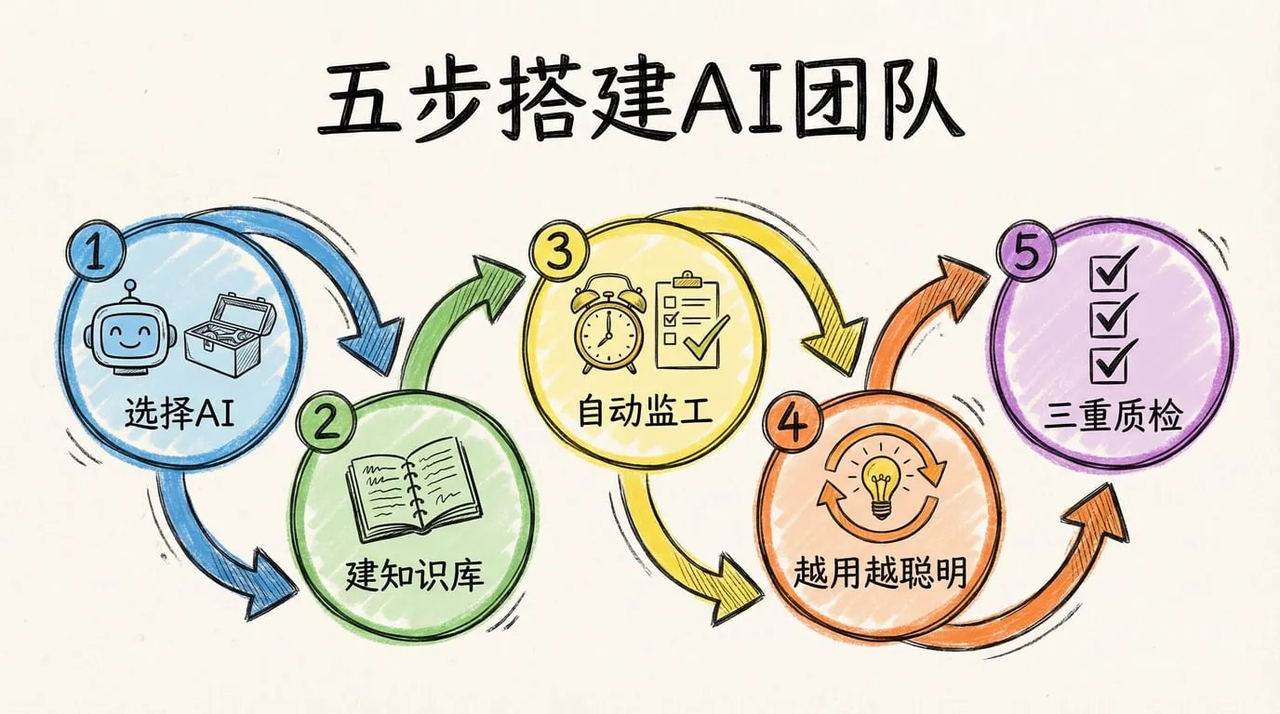

步骤 1:选择你的“项目经理”和“程序员”

你需要:

1 个 AI 项目经理:OpenClaw(免费开源)

至少 2 个 AI 程序员:Codex、Claude Code、Gemini(按需付费)

为什么要多个 AI 程序员? 因为它们各有专长:

Codex:适合复杂逻辑、后端代码、跨文件修改。慢但靠谱,Elvis 90% 的任务用它。

Claude Code:速度快,适合前端界面和 git 操作。

Gemini:设计感强,适合生成漂亮的界面设计稿。

AI 项目经理 Zoe 会根据任务类型自动选择:计费系统的 bug 给 Codex,按钮样式调整给 Claude Code,新页面设计从 Gemini 开始。

你要做的:安装 OpenClaw,配置至少两个 AI 程序员的 API。预算有限的话,先从 Codex + Claude Code 开始。

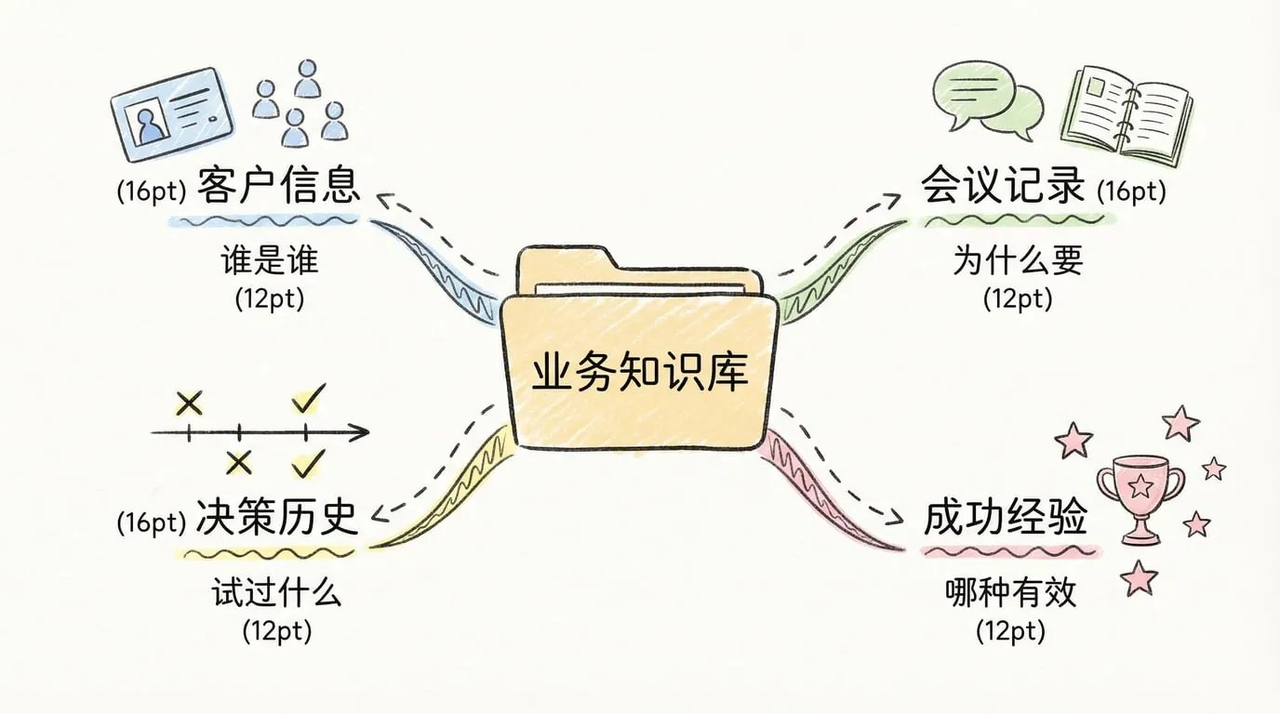

步骤 2:建立“业务知识库”

这是最容易被忽略但最关键的一步。AI 项目经理的价值,就在于它记住了 AI 程序员看不到的信息。

Elvis 用 Obsidian 存储:

客户信息:谁是谁、他们做什么生意

会议记录:客户说了什么、为什么要这个功能

决策历史:我们试过什么、为什么失败了

成功经验:哪种方式有效

当 AI 程序员失败时,Zoe 不是简单重试,而是结合业务背景重新说明任务。比如:

“停!客户要的是 X,不是 Y。这是他们在会议上说的。”

“这是客户的邮件,看看他们公司做什么业务。”

你要做的:选一个笔记工具(Obsidian、Notion、甚至 Word 文档),开始记录:每次客户对话的要点、每个功能决策的原因、每次失败的教训。两周后,你就有一个初步的知识库了。

步骤 3:设置“自动监工”

你需要知道 AI 程序员在做什么,但不能每 5 分钟就去问(太贵)。

Elvis 的方案:用一个文件记录所有任务,用自动脚本定期检查。

每个 AI 程序员开工时,在一个 JSON 文件里创建一条记录:任务是什么、在哪个分支工作、进度如何。一个自动脚本每 10 分钟运行一次,检查:

AI 程序员还在工作吗?

代码提交了吗?

测试通过了吗?

这个脚本不问 AI“你在做什么”(太贵),而是检查可观察的状态。只在真正需要人工干预时(连续失败 3 次、卡住超过 30 分钟)才发警报。

你要做的:创建一个简单的任务记录表(Excel 或 JSON 文件),写一个监控脚本。第一版可以很简单:每 15 分钟检查一次,如果任务超过 1 小时没完成,发邮件提醒你。

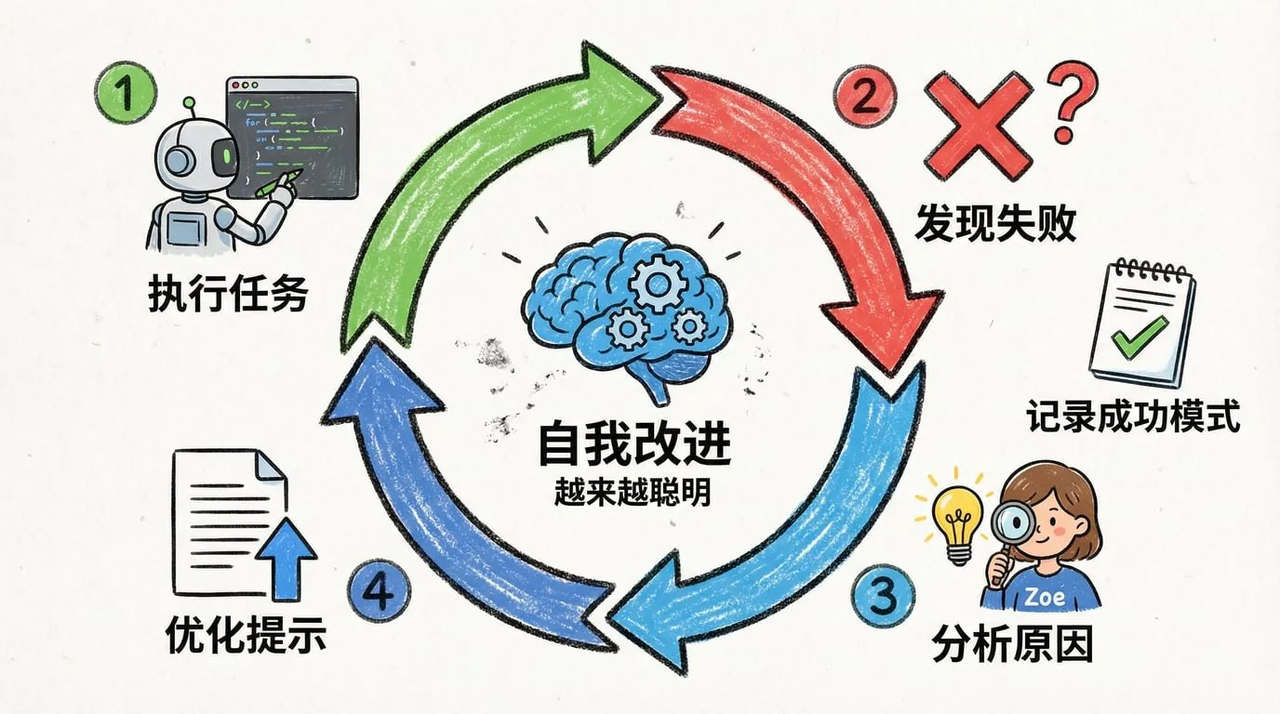

步骤 4:让系统“越用越聪明”

标准的 AI 工作流是:接任务 → 干活 → 提交结果 → 记录经验。但大多数系统的问题是,任务说明本身不会进化。

Elvis 的改进版让 Zoe 能根据失败原因动态调整任务说明。当 AI 程序员失败时,Zoe 会分析:是信息不够?方向错了?需要澄清?然后用业务知识重写任务说明,而不是机械重试。

更厉害的是,Zoe 会主动找活干:

早上:扫描错误日志,发现 4 个新 bug,创建 4 个 AI 程序员去修复

会后:扫描会议记录,标记 3 个功能需求,创建 3 个 AI 程序员去实现

晚上:扫描代码提交历史,创建 AI 去更新文档

Elvis 散步回来,手机通知:“7 个功能做好了。3 个新功能,4 个 bug 修复。”

当 AI 程序员成功时,经验被记录下来:“这种任务说明适合计费功能。” “Codex 需要提前知道数据结构。” 随着时间推移,Zoe 写的任务说明越来越精准。

你要做的:从简单的失败日志开始。每次 AI 失败,记录:任务是什么、为什么失败、你怎么修复的。一个月后,你会看到规律——某些类型的任务总是需要特定的信息。把这些规律教给你的 AI 项目经理。

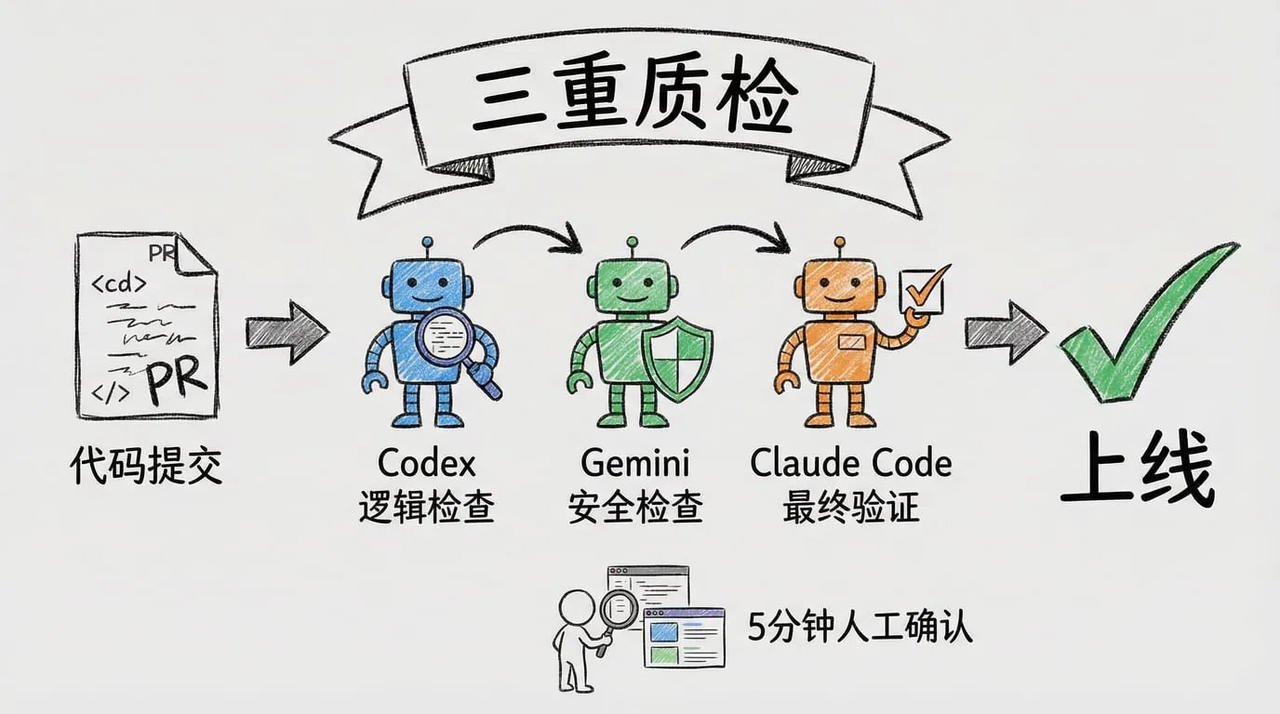

步骤 5:设置“三重质检”

人工检查每个代码提交太慢,但直接上线 AI 写的代码太危险。三重审查是平衡点。

Elvis 用三个 AI 审查每次代码提交:

Codex:最彻底,找逻辑错误和边界情况

Gemini:免费,找安全和性能问题

Claude Code:有点过于谨慎,但能验证其他审查员的发现

三个 AI 直接在代码下面写评论,Elvis 只看标记为“严重”的问题。

他还加了一条规则:如果改了界面,必须附上截图,否则测试不通过。 这让他能在 5 分钟内完成审查,看截图就知道改了什么,不用打开预览环境。

你要做的:至少配置两个 AI 审查员(推荐 Codex + Gemini,因为 Gemini 免费)。让它们直接在代码下写评论。如果你的项目有界面,强制要求截图——这能节省 80% 的审查时间。

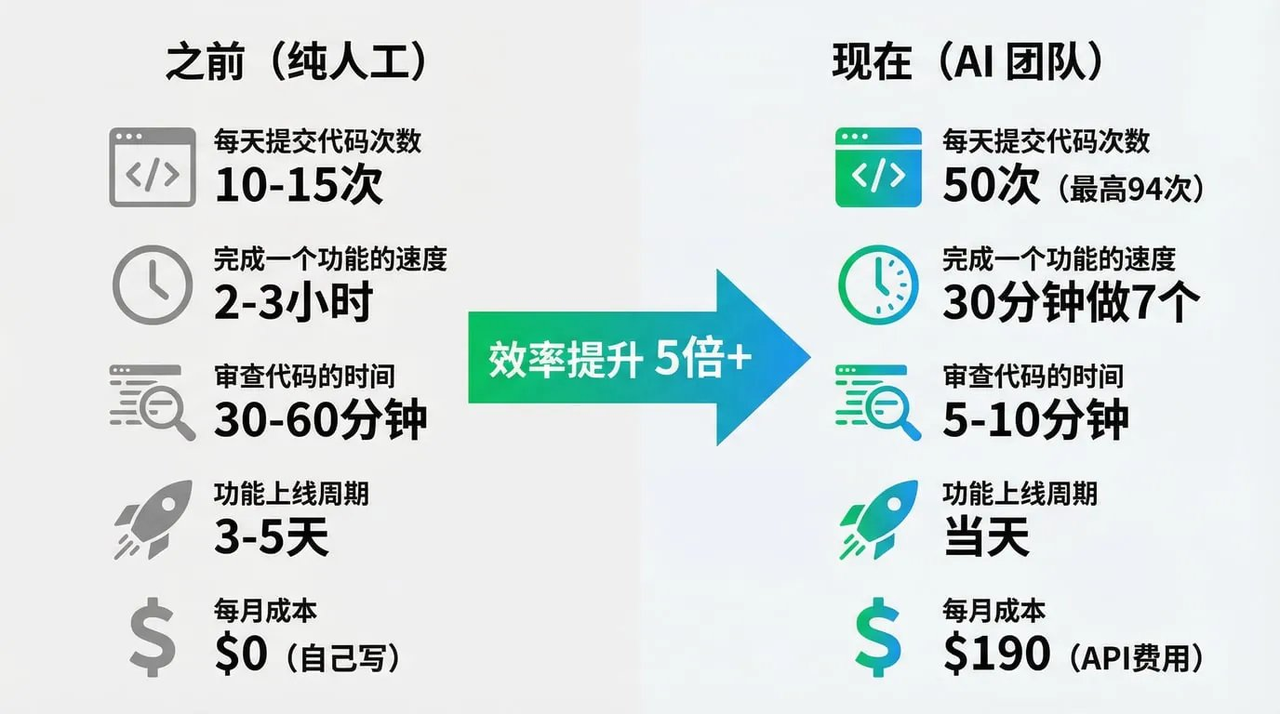

真实效果:从“敲代码”到“做决策”

但系统不是完美的。

Elvis 坦言,复杂的架构决策、跨多个服务的大改动、需要深度专业知识的 bug,还是要他亲自处理。AI 程序员擅长的是“任务明确的中小型工作”,给定清晰的输入和预期输出,它们能一次搞定。

但让我印象深刻的是工作性质的转变。

以前,Elvis 的一天:写代码 6 小时,开会 2 小时。

现在:定义需求 1 小时,审查代码 2 小时,开会 2 小时,其余时间思考战略或休息。

产出反而提高了,从日均 10-15 次提交到 50 次提交。

数据对比:

更重要的是心态转变。Elvis 说:

“不要把 AI 当廉价员工,要把它当力量放大器。我还是要做最重要的决策——产品方向、架构选择、代码质量标准。AI 接管的是我不想做、也不应该做的重复性工作。这让我能专注于只有创始人能做的事:理解客户、定义产品、建立信任。”

从管理代码到管理 AI 团队,他找到了一个人对抗大公司的方法。

10 分钟快速上手

如果你想复制这套系统,最快的方法是:把这整篇文章复制给 OpenClaw,告诉它:“帮我搭建这套系统。”

OpenClaw 会自动创建脚本、设置目录结构、配置监控程序。10 分钟搞定。

核心文件:

.clawdbot/active-tasks.json:任务记录表

scripts/monitor-agents.sh:监控脚本

scripts/spawn-agent.sh:启动 AI 程序员的脚本

.clawdbot/context/:业务知识库

第一次运行时,系统会问你:用哪些 AI 模型?代码在哪里?怎么访问数据库(只读)?回答这些问题,系统就能开始工作了。